Manchmal braucht es eine Weile, bis große Unternehmen erkennen, was jede Nutzer°In schon lange weiß: Bei Microsoft hat es wieder einmal etwas länger gedauert, aber offenbar ist es jetzt soweit: Der Konzern hat eingeräumt, dass er es mit der KI-Integration in Windows 11 ordentlich übertrieben hat.

Pavan Davuluri, Vizepräsident der Windows-Sparte, veröffentlichte Ende März 2026 einen Beitrag mit dem Titel „Our commitment to Windows quality“, und wer zwischen den Zeilen liest, findet dort das selten gewordene Eingeständnis eines Großkonzerns, dass man sich verrannt hat.

Copilot überall, außer dort, wo er gebraucht wird

Das Prinzip ist immer dasselbe. Notepad für eine schnelle Notiz: Copilot. Das Snipping Tool: Copilot. Die Fotos-App: Copilot. Die Taskleiste: Copilot. Neuere Tastaturen haben sogar eine eigens dafür reservierte Taste, die vermutlich niemand absichtlich drückt.

Das Ergebnis ist ein Betriebssystem, das sich anfühlt wie ein Werbeprospekt für ein Produkt, das man gar nicht kaufen wollte. In der Community hat sich der Begriff „Microslop“ durchgesetzt, ein Wort, das Microsoft so wenig mag, dass es auf dem eigenen Copilot-Discord gebannt wurde. Die Reaktion darauf war so heftig, dass der gesamte Discord danach gesperrt wurde. Das gibt einem eine Ahnung davon, wie weit das Vertrauen in den Konzern bereits erodiert ist.

Was bleibt vom Versprechen?

Davuluri verspricht nun Änderungen. Copilot-Einstiegspunkte sollen reduziert werden, konkret nennt er Snipping Tool, Fotos, Widgets und Notepad. Die Taskleiste soll künftig auch links und rechts angeheftet werden können, eine Selbstverständlichkeit, die andere Betriebssysteme seit Jahrzehnten beherrschen. File Explorer soll schneller werden, die Speichernutzung soll sinken.

Das klingt vernünftig. Und es ist ermutigend, dass überhaupt jemand aus der Chefetage öffentlich anerkennt, dass etwas schiefgelaufen ist. Aber die Formulierungen verdienen genaues Hinschauen. Davuluri schreibt, Microsoft werde „intentionaler“ dabei vorgehen, wo und wie Copilot integriert wird, man werde sich auf Erfahrungen konzentrieren, die „genuinely useful and well-crafted“ seien. Das ist keine Absage an die KI-Integration. Das ist eine Ankündigung, sie anders zu verpacken.

Die grundsätzliche Strategie, KI tief in Windows zu verankern, stellt Davuluri nicht in Frage. Copilot soll nützlicher werden, nicht verschwinden.

Was dahintersteckt

Das Problem ist struktureller Natur. Wie bereits im Artikel zu Microsoft und digitaler Souveränität beschrieben, folgt Microsoft einer Logik, die weniger am Nutzererlebnis als an Unternehmenszielen ausgerichtet ist. Copilot ist nicht deshalb in Notepad gelandet, weil irgendjemand in einer Nutzerbefragung gesagt hat, er brauche KI-Unterstützung beim Schreiben von Einkaufslisten. Copilot ist dort gelandet, weil Microsoft Milliarden in OpenAI investiert hat und diese Investition durch möglichst viele Berührungspunkte mit der eigenen Nutzerbasis amortisieren will.

Das ist keine Kritik an KI als solcher. KI kann nützlich sein, an den richtigen Stellen, wenn man sie selbst aufruft, wenn sie eine echte Aufgabe löst. Das Problem ist die Zwangsbeglückung: die Überzeugung in der Konzernspitze, dass Nutzerinnen und Nutzer etwas nur oft genug sehen müssen, um es zu wollen.

Dieselbe Logik, die dazu geführt hat, dass KI-Zusammenfassungen in Suchergebnissen stehen, die zu 60 Prozent fehlerhaft sind, hat auch Copilot in jede Ecke von Windows getrieben. Die Technik ist nicht unbedingt das Problem. Das Geschäftsmodell dahinter ist es.

Nebenbei: ein Sicherheitsproblem

Was in der Diskussion um nervige KI-Features gerne untergeht: die konkrete Gefahr, die aus schlecht integrierten KI-Funktionen entsteht. Als Microsoft Copilot in Notepad integrierte, entdeckten Sicherheitsforscher eine gravierende Schwachstelle: Das Modell ließ sich durch manipulierte Texte (sogenannte Prompt-Injection) dazu bringen, Schadcode auszuführen. Der Patch kam nachträglich. Das Sicherheitsproblem war der Preis für übereilte KI-Integration, für Features, die Microsoft in sein Betriebssystem presste, ohne sie zu durchdenken.

Wohin führt das?

Die Reaktion der Nutzerschaft ist eindeutig. Teile der Windows-10-Nutzerbasis weigern sich, auf Windows 11 umzusteigen. Die Linux-Community verzeichnet wachsendes Interesse und Linux-Installationen stiegen sprunghaft an, unter anderem wegen der aufgezwungenen KI-Funktionen, aber natürlich auch wegen der aus der Luft gegriffenen Hardware-Anforderungen. Apples MacBook Neo, das zu konkurrenzfähigen Preisen daher kommt, wird als Alternative diskutiert. Die Frustration hat einen Namen bekommen: Microslop. Und Microsofts Reaktion auf diesen Namen, Zensur und dann Rückzug, zeigt, dass der Konzern das Ausmaß des Imageschadens zumindest ahnt.

Davuluris Text ist ein erster Schritt. Aber erste Schritte sind nur dann etwas wert, wenn danach auch zweite folgen. Die Frage ist, ob Microsoft den Mut aufbringt, nicht nur die Sichtbarkeit von Copilot zu reduzieren, sondern das Verhältnis zum eigenen Produkt grundlegend zu überdenken. Ein Betriebssystem ist kein Vehikel für KI-Marktanteile. Es ist ein Werkzeug, das funktionieren soll, zuverlässig, schnell, ohne Gedränge. So wie Linux.

Das wissen die Nutzerinnen und Nutzer schon lange. Microsoft lernt es gerade.

p.s.: Man kann Copilot in Windows 11 komplett deaktivieren, das erfordert allerdings ein wenig Handarbeit. Alternativ nutzt man das Tool Flyoobe, auch hier sollte man aber wissen, was man tut. Auf allen meiner Windows-Rechner wurde Copilot erfolgreich entfernt.

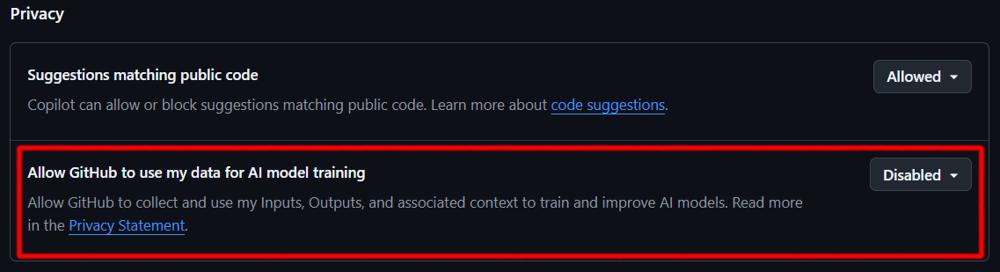

Update: Ob man Microsoft bei diesen Ankündigungen trauen kann? Der Konzern macht eventuelle Vertrauensvorschüsse durch eine neue Meldung gleich wieder kaputt: man kündigt auf Github an, umfangreich daten fürs KI-Training zu sammeln: „We collect all your inputs, outputs and associated context to train and improve AI models“. Das ist automatisch aktiv, man muss es in den Einstellungen deaktivieren:

https://github.com/settings/copilot/features

Nicht sehr vertrauenerweckend.

Quellen:

- Pavan Davuluri: „Our commitment to Windows quality“, Microsoft Windows Insider Blog, 20. März 2026 (blogs.windows.com)

- Victor Tangermann: „Microsoft Realizes It’s Epically Screwed Up Windows 11 as Users Rage at Copilot AI Crammed Everywhere“, Futurism, 23. März 2026 (futurism.com)

- Futurism: „Microsoft Added AI to Notepad and It Created a Security Failure“, Februar 2026 (futurism.com)

- Futurism: „Microsoft Bans the Word ‚Microslop‘ on Copilot Discord“, März 2026 (futurism.com)

- Futurism: „Vast Number of Windows Users Refusing to Upgrade After Microsoft’s Embrace of AI Slop“, Dezember 2025 (futurism.com)

Bild von DigitalIceAge, CC BY 4.0 <https://creativecommons.org/licenses/by/4.0>, via Wikimedia Commons, bearbeitet von mir